Die Bilderflüsterer – Wie KI-Bilder unsere Medienwelt revolutionieren

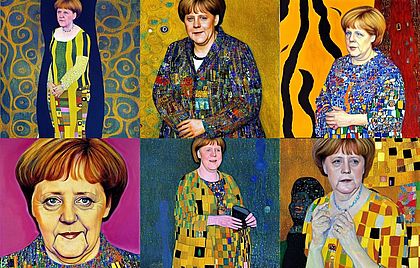

Eine KI-Bilder-Collage der früheren Bundeskanzlerin Angela Merkel im Stil des Künstlers Gustav Klimt, die mit dem KI-Bildgenerator Stable Diffusion erstellt wurde. | CCO

KI-Bildgenerator Stable Diffusion erschafft Bilder aus dem Nichts

Bilder aus dem Nichts zu erschaffen: Das war lange Zeit der kreativen Hand von Kunstschaffenden oder Grafikdesigner/-innen vorbehalten. Spätestens mit dem Bildgenerator Stable Diffusion, der auf künstlicher Intelligenz (KI) basiert und im Sommer unter einer Open-Source-Lizenz veröffentlicht wurde, ändert sich dies nun. Laien können damit auf ihrem handelsüblichen Computer nie dagewesene Bilder in höchster Qualität entstehen lassen – per simpler Texteingabe. Seien es Fotos real aussehender Menschen, Gemälde im Stil bekannter Künstler oder utopisch anmutende „Mondlandschaften“. Eine neue Generation von „Bilderflüsterern“ steht in den Startlöchern.

Haus, Katze oder Mensch: Wie erkennen KI-Modelle Bilder?

KI-Bildgeneratoren wie Stable Diffusion basieren auf künstlicher Intelligenz in Form sogenannter neuronaler Netzwerke. Bis ein solches Netzwerk zum „Künstler“ werden kann, muss es üben, üben, üben – im Falle von Stable Diffusion mit 2,3 Milliarden Bildern aus Internetquellen wie Pinterest, Flickr, Etsy oder Adobe Stock. Durch dieses ausgedehnte Training lernt das KI-Modell, die abgebildeten Objekte und Personen mithilfe charakteristischer Merkmale richtig zu „kategorisieren“: zum Beispiel als Haus, Katze oder Mensch.

Für eine KI ist jedes Bild zunächst ein „Zahlenhaufen“, bestehend aus einem Zahlenwert für jeden Pixel des Bildes. Was sich hinter diesem Zahlenhaufen verbirgt, findet das KI-Modell heraus, indem jede Schicht seines neuronalen Netzwerks eine Art Filter über das Bild legt. Aus Pixeln mit ähnlichen Helligkeitswerten kristallisieren sich nach und nach einfache geometrische Formen wie Linien, Ecken oder Kreise und schließlich komplexe Muster wie Augen oder Fellpartien heraus. Auf Basis dieser Muster kann das KI-Modell ein Bild zum Beispiel dem Begriff Katze zuordnen.

Bilderflüstern für Anfänger: Wie funktionieren KI-Bildgeneratoren?

Bis eine künstliche Intelligenz allerdings Katzen und Hunde nicht nur voneinander unterscheiden, sondern diese auch aus dem Nichts entstehen lassen kann, muss es ein weiteres Trainingslager durchlaufen. Hierzu erhält das Modell immer stärker verpixelte Bilder. Diese muss es mitsamt den enthaltenen Objekten, Personen und Hintergründen in einen hochaufgelösten Zustand zurückversetzen. So trainiert, kann das KI-Modell schließlich auch aus einem komplett verpixelten Bild – also einer weißen Fläche – ein neues, nie dagewesenes Bild generieren.

An dieser Stelle kommen wir Menschen als „Bilderflüsterer“ ins Spiel. Indem wir z.B. den Text „Katze mit Sonnenbrille im Stil von Gustav Klimt“ in den Bildgenerator eingeben, gaukeln wir dem KI-Modell Gewissheit darüber vor, was in dem komplett verpixelten Bild zu sehen sei. Durch die Texteingabe lenken wir also den „Schaffensprozess“ des KI-Künstlers in eine bestimmte Richtung. Ein „Bild nach Maß“ entsteht.

Übrigens: Mithilfe der Unterrichtsidee „#deeplearning: Erkennen von Bildern mit neuronalen Netzen“ können Sie Ihren Schülerinnen und Schülern auf einfache Weise erklären, wie KI-Modelle Personen und Objekte erkennen kann.

Bilderflüstern für Fortgeschrittene: Welche Probleme bringen KI-Bildgeneratoren mit sich?

Urheberrecht

So faszinierend und witzig diese Technologie für Nutzer/-innen auf den ersten Blick erscheint, so gruselig und ernstzunehmend könnten ihre Folgen für unsere Medienlandschaft und Gesellschaft sein. Wenn künstlerische Werke „per Knopfdruck“ entstehen: Wer kann dann als Urheber dieser Werke gelten – die Nutzer/-innen oder Entwickler/-innen des KI-Modells, die Künstler/-innen oder Fotografen der Trainingsbilder oder gar das KI-Modell selbst? Um sich rechtlich abzusichern, haben einige große Bildagenturen wie Getty oder Shutterstock bereits ihren Verzicht auf den Einsatz von KI-Kunst erklärt.

Künstler/-innen und Grafikdesigner/-innen, die um ihr geistiges Eigentum fürchten, haben erste Ideen zu einem „digitalen Wasserzeichen“ entwickelt. Idealerweise könnte man damit in Zukunft nicht nur handgemachte Originalquellen identifizieren, sondern auch gezielt den Einsatz eines Werkes für KI-Trainingszwecke erlauben oder nicht. Ob solche Nutzungsvorbehalte dann auch eingehalten würden, dürfte jedoch in der Realität schwer nachzuprüfen sein. Häufig liegen die Trainingsdaten für KI-Modelle gar nicht offen – und wenn sie es wie im Falle von Stable Diffusion tun, handelt es sich um Milliarden von Daten.

Pornografie und Fake News

Schwerer noch als die urheberrechtlichen Bedenken wiegen jedoch die Sorgen um den Missbrauch der neuen Technologie zum Beispiel zur Darstellung von Pornografie. Anders als die KI-Bildgeneratoren DALL-E oder Midjourney erlaubt Stable Diffusion seinen Nutzerinnen und Nutzern, künstliche Nacktbilder sowie Bilder von prominenten Personen zu erstellen. Außerdem können User auch „eigene“ Bilder als Vorlagen für neue KI-Bilder hochladen. Ob es sich dabei um eigene Fotos oder um Fotos Dritter aus Social-Media-Profilen handelt, lässt sich nur schwerlich nachprüfen.

Auf diese Weise kann mit Stable Diffusion jedermann nicht nur künstliche Pornografie, sondern auch ungewollte Deepfake-Pornografie von Prominenten oder Privatpersonen erstellen. Mit dem KI-Bildmaterial könnten die Opfer dann erpresst und öffentlich verleumdet werden. Im Internetforum 4chan haben sich bereits erste Communitys gebildet, die sich genau diesem pornografischen Einsatz von KI-Bildgeneratoren widmen.

Ähnlich schwerwiegende Folgen könnte der Einsatz von KI-Bildgeneratoren auch für die Verbreitung von Fake News und Desinformation haben. Künstliche Bilder, die exakt zu einer Falschnachricht passen, könnten die Glaubwürdigkeit dieser Nachricht massiv erhöhen. Fakten von Fake zu unterscheiden, könnte dadurch in der Zukunft für Mediennutzer/-innen noch schwieriger werden als bislang. Denn nicht als Realität wahrzunehmen, was wir vor Augen haben, läuft ein Stück weit unserer menschlichen Natur entgegen.

Online-Archiv für KI-Bilder des Generators Stable Diffusion